近年、AI(人工知能)は私たちの生活に深く浸透しています。

スマートフォンの音声アシスタントやオンラインのおすすめ機能、さらには医療診断や自動運転まで、AIの技術はあらゆる場面で活用されるようになっています。

2018年からAIと関わってきた経験から、この技術の普及とともに、当初の「ロボットによる支配」への恐れは薄れ、代わりに日常のビジネス構造へのAI統合を取り巻く倫理的議論が盛んになってきています。

本記事では、AIの倫理とは何か、そして私たちの生活やビジネスにどのような影響を与えるのかを詳しく解説します。

- AIの倫理的役割とその重要性

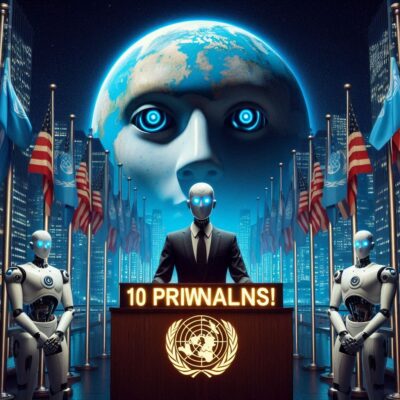

- 国連によるAIの10の倫理原則

- 1. まず、害を与えないこと(First, do no harm)

- 2. AIのためのAIを避ける(Avoid AI for AI’s sake)

- 3. 安全とセキュリティ(Safety and security)

- 4. 平等(Equality)

- 5. 持続可能性(Sustainability)

- 6. データプライバシー、データ保護、データガバナンス(Data privacy, data protection and data governance)

- 7. 人間による監視(Human oversight)

- 8. 透明性と説明可能性(Transparency and Explainability)

- 9. 責任と説明責任(Responsibility and Accountability)

- 10. 包括性と参加(Inclusivity and participation)

- AIと共に生きるために

AIの倫理的役割とその重要性

AIの導入が進む中、倫理、ガバナンス、コンプライアンスを扱う新たな役割が組織にとって非常に価値のあるものになっています。

最も重要なのは「AI倫理専門家」で、エージェント型AIシステムが公平性や透明性などの倫理基準を満たすことを確保する役割を担います。

このポジションでは、特殊なツールやフレームワークを使用して倫理的懸念に効率的に対処し、法的またはレピュテーションリスクを回避します。

データ駆動型の意思決定、インテリジェンス、直感のバランスを維持するためには、透明性と責任ある倫理を確保するための人間の監視が不可欠です。

さらに「エージェント型AIワークフローデザイナー」や「AI相互作用・統合デザイナー」などの役割は、AIがエコシステム全体にシームレスに統合され、透明性、倫理的考慮事項、適応性を優先することを確保します。

また、AIの意思決定要素であるエージェントと仲裁者からなるエージェント型スタック全体を監視する「AIオーバーシーア」も必要とされています。

国連によるAIの10の倫理原則

組織にAIを導入し、責任を持って技術を導入・維持したいと考える人には、国連の原則を参照することをお勧めします。

これらの10原則は、AIの普及による倫理的課題に対応するため、2022年に国連によって作成されました。

以下、その原則と枠組みとしての活用方法を解説します。

1. まず、害を与えないこと(First, do no harm)

自律的要素を持つ技術にふさわしく、最初の原則は、社会的、文化的、経済的、自然的、政治的環境に悪影響を与えない方法でのAIシステムの展開に焦点を当てています。

AIのライフサイクルは、人権と自由を尊重し保護するように設計されるべきです。

システムは、その状況が維持され、長期的な損害が発生しないことを確保するために監視される必要があります。

2. AIのためのAIを避ける(Avoid AI for AI’s sake)

AIの使用が正当であり、適切であり、過度でないことを確認します。

この魅力的な技術の適用に過度に熱心になる明確な誘惑があり、人間のニーズと目標とのバランスを取る必要があり、決して人間の尊厳を犠牲にして使用されるべきではありません。

3. 安全とセキュリティ(Safety and security)

AIシステムのライフサイクル全体を通じて、安全とセキュリティのリスクを特定し、対処し、軽減する必要があります。

ビジネスの他の領域と同様に、AIにも堅牢な健康と安全のフレームワークを適用すべきです。

4. 平等(Equality)

同様に、AIは利益、リスク、コストの平等かつ公正な分配を確保し、あらゆる種類の偏見、欺瞞、差別、スティグマを防ぐことを目的として展開されるべきです。

5. 持続可能性(Sustainability)

AIは環境的、経済的、社会的持続可能性を促進することを目的とすべきです。

将来の世代への影響を含め、負の影響に対処するための継続的な評価が行われるべきです。

6. データプライバシー、データ保護、データガバナンス(Data privacy, data protection and data governance)

個人のプライバシーと権利がデータ整合性と個人データ保護に関する法的ガイドラインに沿って維持されることを確保するために、適切なデータ保護フレームワークとデータガバナンスメカニズムを確立または強化すべきです。

AIシステムは他の人間のプライバシーを侵害すべきではありません。

7. 人間による監視(Human oversight)

AIの使用結果が公正であることを確保するために、人間による監視が保証されるべきです。

人間中心の設計手法を採用し、いつでも人間が介入してAIの使用方法と時期を決定し、AIによる決定を覆す能力を与えるべきです。

国連は劇的ではあるが全く合理的に、生死に関わる決定はAIに任せるべきではないと提案しています。

8. 透明性と説明可能性(Transparency and Explainability)

これは平等に関するガイドラインの一部を形成します。AIを使用する全ての人は、使用しているシステム、システムによる意思決定プロセス、その影響を完全に理解すべきです。

個人の権利、自由、または利益に関する決定が人工知能によって行われた場合、個人に通知されるべきであり、最も重要なことに、説明は理解可能な方法で行われるべきです。

9. 責任と説明責任(Responsibility and Accountability)

これは、AIによる決定と使用に対して誰かが責任を持ち、説明責任を負うことを確保するための、監査とデューデリジェンス、および内部告発者の保護をカバーする内部告発者原則です。

AIベースの決定に対する人間の倫理的・法的責任に関するガバナンスが導入されるべきです。

危害を引き起こすこれらの決定は調査され、措置が取られるべきです。

10. 包括性と参加(Inclusivity and participation)

ビジネスの他の領域と同様に、人工知能システムの設計、展開、使用に際しては、ジェンダー平等も含めた包括的、学際的、参加型のアプローチを取るべきです。

ステークホルダーおよび影響を受けるコミュニティは、利益と潜在的リスクについて情報提供され、相談を受けるべきです。

AIと共に生きるために

AIの進化を止めることはできませんが、私たちがその倫理的課題を理解し、適切に向き合うことは可能です。

政府や企業はAIの倫理に関するルール作りを進めていますが、私たち個人もできることがあります。

組織がAIを導入する際は、これらの中心的な柱を基盤として構築することで、AIの統合が倫理的かつ堅固な基盤の上に構築されていると確信できるでしょう。

まず、AIがどのように機能し、どのようなリスクを伴うのかを学ぶことが重要です。

例えば、プライバシーを守るために SNS の設定を見直し、個人データの共有範囲を限定することが有効です。

また、企業が提供するAIサービスの透明性をチェックし、公平で信頼できるものを選ぶことも私たちの責任の一部です。

さらに、AIが公正に運用されるように、消費者としての意見を発信することも大切です。

例えば、バイアスのないAIを求める声を企業に届けたり、倫理的なAIを推進する団体を支援したりすることで、より良い社会の実現に貢献できます。

AIの倫理について考えることは、より良い未来を築くための第一歩です。

AIがもたらす利便性を享受しながらも、そのリスクを理解し、公平で安全な社会を目指していきましょう。

私たち一人ひとりが意識を持ち、積極的に行動することで、AIと共存する未来をより良いものにすることができるのです。

コメント